Il n'y aurait pas de "sandbox" chez Google ? Vraiment ?

Ecrit par Marc Grosvalet

le

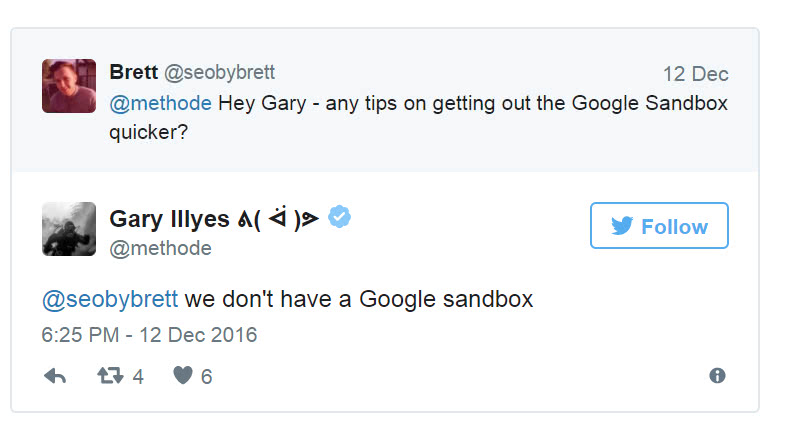

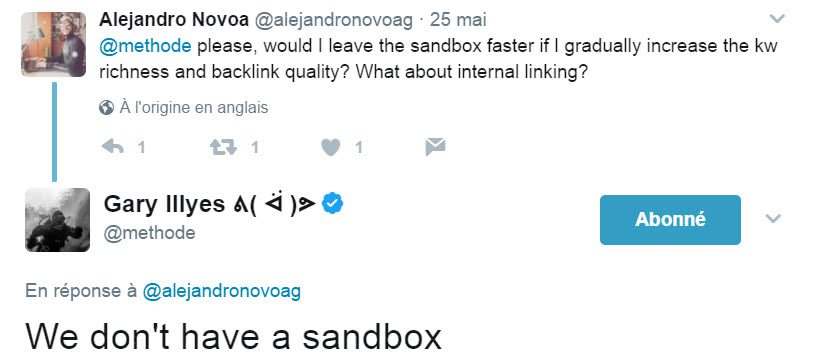

Le 27 mais dernier, en réponse à une question d’un internaute sur Twitter qui lui demandait s’il y’avait moyen de sortir de la « Sandbox » plus rapidement, l’un des porte parole de Google, Gary Illyes, vient d’affirmer dans un tweet que Google n’a pas de « Sandbox ».

La Sandbox chez Google, les featured snippets, Google Marketing Next 2017

Ce que les SEO appellent traditionnellement la « Sandbox ».

Le concept de « Sandbox » remonte à 2004, date à laquelle certains webmasters ont constaté que des nouveaux sites avaient tendance à ne pas être aussi bien classés dans Google qu’ils le devraient, une sous-performance qui pouvait durer plusieurs semaines, voire plusieurs mois après leur lancement. Tout se passait comme si ces nouveaux sites étaient cantonnés à « un bac à sable », le temps de faire leur preuve.

Une courbe montrant le trafic organique d’un site atteint du syndrome de la « Sandbox » : pendant plusieurs mois, le trafic reste très faible, avant de décoller d’un seul coup. Est-ce l’effet de l’algorithme de Google ou du délai nécessaire pour que les indicateurs du site se renforcent ?

2005, Matt Cutts confirme qu’il y’a des choses dans l’algorithme qui peuvent ressembler à l’effet Sandbox.

Dans une interview menée par Brett Tabke lors de la conférence PubCon 2005, Matt Cutts avait répondu qu’il y’avait déjà des choses dans l’algorithme qui peuvent être perçues comme ce que les SEO appellent la Sandbox.

2016/2017 : il n’y a pas de Sandbox chez Google

Gary Illyes a été interrogé deux fois ces derniers temps sur la Sandbox via Twitter. Dans les deux cas, Gary a donné la même réponse.

Alors, Sandbox ou pas Sandbox ?

En fait, cela fait très longtemps qu’on continue à utiliser le terme Sandbox, alors que l’on sait :

- que Google n’a effectivement rien dans son algorithme qui s’appelle un « bac à sable ». Il est donc logique qu’à chaque question sur le sujet, les interlocuteurs chez Google nient l’existence de la sandbox.

- que l’algorithme peut produire des effets ressemblant à la Sandbox, sans qu’il soit nécessaire de créer un filtre pénalisant les nouveaux sites.

En effet, de nombreux signaux utilisés par Google :

- soit mettent du temps à monter en puissance (par exemple les notes de popularité)

- soit tiennent compte de la temporalité (l’évolution du site dans le temps) pour détecter les tentatives de spam.

En 2012, John Mueller expliquait ceci dans le forum d’aide de Google :

« It can take a bit of time for search engines to catch up with your content, and to learn to treat it appropriately. It’s one thing to have a fantastic website, but search engines generally need a bit more to be able to confirm that, and to rank your site – your content – appropriately ».

Il est donc normal que certains nouveaux sites doivent passer par une phase où il leur sera difficile d’obtenir des places élevées dans les classements.

Mais, visiblement, Google n’aime pas le terme « Sandbox », et surtout ce qui est sous entendu derrière : la présence d’un filtre spécial, ciblant les nouveaux sites. Il n’y a probablement rien de tel en effet dans l’algorithme de Google.

Est-ce que cela veut dire qu’il n’y a rien du tout dans l’algorithme qui tienne compte de la temporalité ?

On ne peut hélas rien déduire d’utile des dénégations laconiques de Gary Illyes.

A part qu’il est inutile d’interroger Gary sur quelque chose qui, d’après lui, n’existe pas.