Presse en ligne : comment valoriser vos contenus dupliqués ?

Ecrit par Marc Grosvalet

le

Avoir du contenu exclusif et unique, c’est le mantra de tous les journaux papiers et online depuis toujours, mais pas seulement : c’est aussi la ligne directrice de toute bonne stratégie SEO. Une étude relayée par l’INA démontre néanmoins que la presse en ligne souffre d’un grave problème de duplicate content, imputable à la course à l’information menée par les géants de l’infotainment.

Les contenus dupliqués, une épine dans le pied de la presse en ligne

La rédaction de InaGlobal.fr a publié un article qui résume dans les grandes lignes le livre L’information à tout prix de Julia Cagé, Marie-Luce Viaud et Nicolas Hervé et dans lequel sont soulevées les questions de l’instantanéité et de l’unicité du contenu.

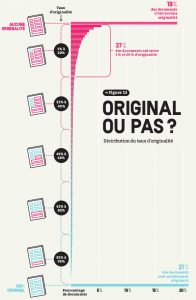

Résumons le résumé : selon leur étude, 64% de ce qui est publié ne serait que du copié/collé pur et simple (cette phrase en est l’illustration) et 56% des articles publiés par la presse en ligne présenteraient moins de 20% de contenu original. 80% des contenus ne seraient donc que des reprises de contenus (bonjour les dépêches AFP !) à faible valeur ajoutée.

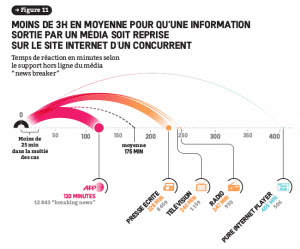

Pis encore, il faudrait moins de 25 minutes à la moitié des concurrents d’un media pour relayer une information « maison » :

L’originalité des contenus, un enjeu majeur

Mais quel rapport avec le SEO me direz-vous ? Eh bien, c’est assez simple : qui dit contenu copié/collé un peu partout, dit contenu dupliqué ou quasi dupliqué… Google n’aime pas ça, et nous non plus !

On le sait, tirer son épingle du jeu n’est pas facile dans le secteur concurrentiel de la presse en ligne, d’autant plus à l’ère des Fake News. Contrairement à ce que l’on entend souvent, les contenus riches et les enquêtes étayées ne sont pas la chasse gardée de la presse écrite. Malheureusement, rédiger de tels contenus nécessite un effort rédactionnel important, que l’audience ne récompense pas toujours à sa juste valeur. A l’heure de l’ubiquité nomade, si les lecteurs ne sont pas contre approfondir certains sujets, le temps est compté et une prime d’audience est souvent accordée aux médias les plus réactifs.

Vous aussi, vous trouvez que l’on s’éloigne du sujet SEO ? Et pourtant… Google n’aime pas le contenu de faible qualité et/ou dupliqué. Il nous a d’ailleurs affublés il y a un petit moment déjà d’un gentil Panda pour l’éradiquer. Difficile donc à la fois de travailler pour avoir de l’exclusivité et de la qualité et en même temps de se résoudre à potentiellement ne pas plaire à Google et parfois pire, de se faire coiffer au poteau par un concurrent : « Si un autre site a le même contenu que le vôtre et qu’il a de meilleurs signaux de positionnement que le vôtre, il risquera de se positionner mieux que vous » nous contait il y a peu Zineb Ait Bahajji, Program Manager chez Google.

Comment évaluer et monitorer ce problème de duplicate content ?

Si les medias ne peuvent s’approprier certains contenus comme les dépêches AFP, ils doivent néanmoins surveiller la reprise partielle ou non de leurs contenus originaux. Ce travail peut être fait via un outil comme Kill Duplicate, mais il est également possible de le faire via des « commandes » ou des « search operators Google » comme celui-ci : intitle: »le titre de mon article » -site:monsiteàmoi.com qui permet de faire ressortir les pages avec le même title que vous. Vous pouvez faire la même chose également en remplaçant le « intitle » par un « intext ».

L’inconvénient, c’est que cette stratégie s’adopte plutôt a posteriori et ne vous permettra pas de contrer tous les cas illégitimes de duplication de contenu. D’autres mesures sont à prendre en amont.

Gagner la course à l’indexation

Gagner la course à l’indexation doit être la première de vos batailles. Avant de penser au positionnement et au ranking, votre objectif doit être de faire indexer votre contenu le plus rapidement possible par Google. Pour cela le mieux reste encore de soumettre à l’indexation votre page depuis l’onglet Explorer comme Google de votre Google Search Console. Bien entendu, vous devrez également lister vos URLs dans un fichier Sitemap optimisé. Les sites media n’ont pas intérêt à lister leurs archives dans ce fichier, qui doit uniquement servir de rampe de lancement dédiée aux nouvelles URLs.

D’autres moyens plus officieux existent pour accélérer le crawl de vos URLs et leur indexation. La plateforme SubPubHubbub propose ainsi de distribuer vos contenus sur des flux RSS comme Google Reader, Friendfeed ou Feedburner – un plugin WordPress existe pour les adeptes de ce CMS, non testé par SF. Une façon comme une autre de pinguer Google, sans doute plus accessible aux profanes que le développement d’un script…

Des synergies à développer entre vos contenus chauds et froids

Remporter la course à l’indexation est une chose, bien positionner son contenu en est une autre. Etre indexé en premier ne garantira absolument pas à votre contenu de truster les premières pages de la SERP et du carrousel AMP. Au-delà des optimisations SEO classiques permettant de mieux ranker, il conviendra de mettre en place un maillage interne intelligent pour valoriser vos contenus originaux comme ceux plus génériques.

80% de vos articles sont repris de l’AFP et vous ne pouvez y toucher ? Optimisez vos templates afin que les pages associées à ces dépêches redirigent vers vos contenus originaux ! Les contenus chauds, à faible durée de vie, doivent vous permettre d’attirer de l’audience à court terme tout en envoyant du Pagerank vers vos contenus originaux. L’optimisation des ancres vous permettra de multiplier les signaux sémantiques renvoyés sans toucher au contenu de vos dépêches.

Tout l’enjeu consiste alors à choisir les bonnes pages support, les bonnes pages cibles mais également les bons mots-clés… Une expertise que nous serions ravis de vous apporter ! 🙂